-

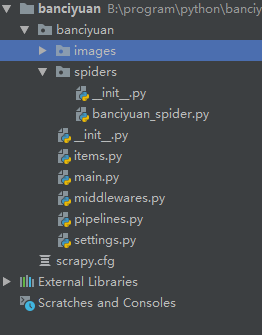

怎么在Python中使用Scrapy爬取豆瓣图片

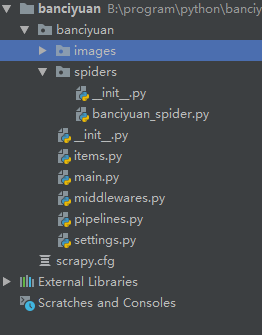

1.首先我们在命令行进入到我们要创建的目录,输入 scrapy startproject banciyuan 创建scrapy项目创建的项目结构如下2.为了方便使用pycharm执行scrapy项目,新建main.pyfromscrapyimportcmdlinecmdline.execute(&q... ...

0 回应 13 热度 -

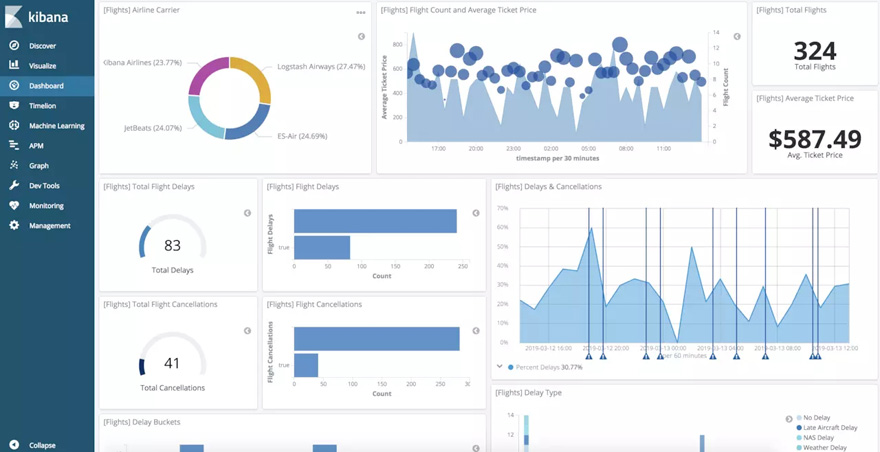

如何免费创建云端爬虫集群

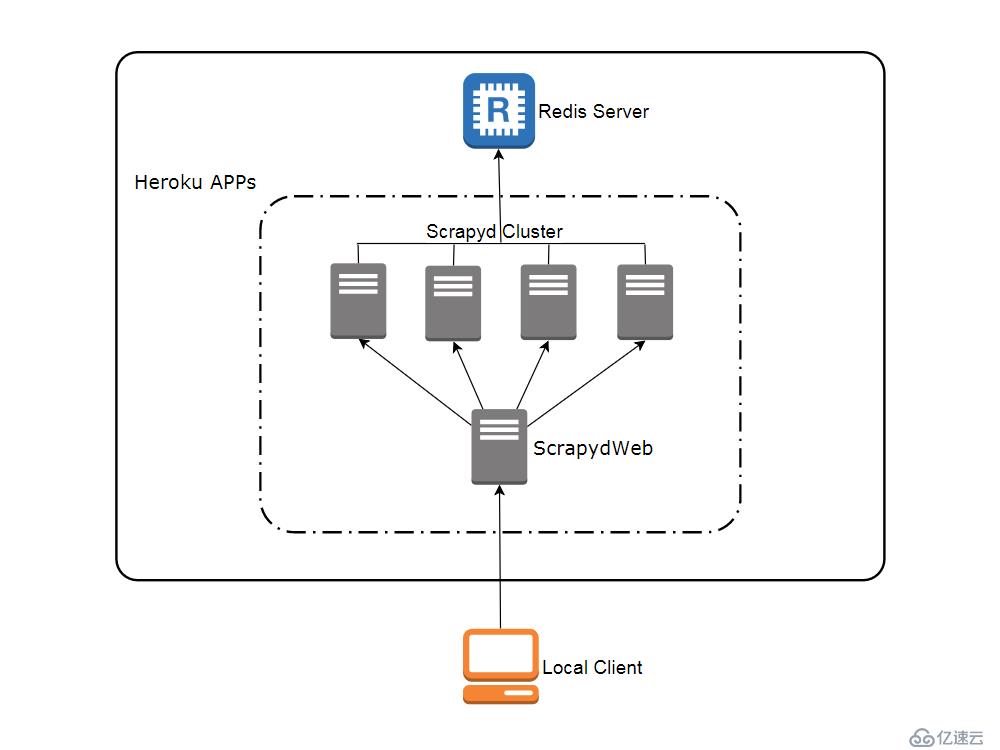

在线体验scrapydweb.herokuapp.com网络拓扑图注册帐号访问 heroku.com 注册免费账号(注册页面需要调用 google recaptcha 人机验证,登录页面也需要科学地进行上网,访问 app 运行页面则没有该问题),免费账号最多可以创建和运行5个 app。... ...

0 回应 1 热度 -

Python Scrapy图片爬取的方法

1.在爬虫文件中只需要解析提取出图片地址,然后将地址提交给管道在管道文件对图片进行下载和持久化存储class ImgSpider(scrapy.Spider): name = 'img' # allowed_domains = ['www.xxx.com'] ... ...

0 回应 4 热度 -

scrapy导出文件时出现中文乱码怎么办

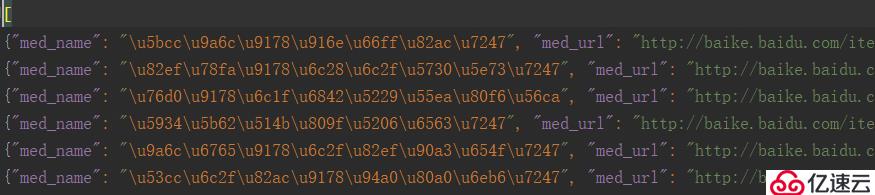

scrapy导出文件时出现中文乱码怎么办?相信很多没有经验的人对此束手无策,这篇文章总结了scrapy导出文件时出现中文乱码的解决办法,通过这篇文章希望你能解决这个问题。背景:使用scrapy crawl spidername -o filename.json命令执行爬虫,并将item写入文件,发现中文... ...

0 回应 2 热度 -

一步步教你用python的scrapy编写一个爬虫

介绍本文将介绍我是如何在python爬虫里面一步一步踩坑,然后慢慢走出来的,期间碰到的所有问题我都会详细说明,让大家以后碰到这些问题时能够快速确定问题的来源,后面的代码只是贴出了核心代码,更详细的代码暂时没有贴出来。流程一览首先我是想爬某个网站上面的所有文章内容,但是由于之前没有做过爬虫(也... ...

0 回应 4 热度 -

python中scrapy指的是什么

Scrapy是Python开发的一个快速、高层次的屏幕抓取和web抓取框架,用于抓取web站点并从页面中提取结构化的数据。Scrapy用途广泛,可以用于数据挖掘、监测和自动化测试。Scrapy吸引人的地方在于它是一个框架,任何人都可以根据需求方便的修改。它也提供了多种类型爬虫的基类,如BaseSpide... ...

0 回应 9 热度 -

怎么在Python中使用Scrapy爬取豆瓣图片

1.首先我们在命令行进入到我们要创建的目录,输入 scrapy startproject banciyuan 创建scrapy项目创建的项目结构如下2.为了方便使用pycharm执行scrapy项目,新建main.pyfromscrapyimportcmdlinecmdline.execute(&q... ...

0 回应 16 热度 -

python基于Scrapy怎么从数据库获取URL进行抓取

代码如下:importpymysqlclassMySpider(scrapy.Spider):MAX_RETRY=10logger=logging.getLogger(__name__)name='myspider'start_urls=[]@classmethodde... ...

0 回应 9 热度 -

scrapy远程登录控制台如何实现

远程登录控制台Scrapy附带一个内置的telnet控制台,用于检查和控制Scrapy运行过程。telnet控制台只是一个运行在scrappy进程内部的常规python shell,因此您可以从中做任何事情。telnet控制台是一个 built-in Scrapy extension 它在默认情况下是启... ...

0 回应 6 热度 -

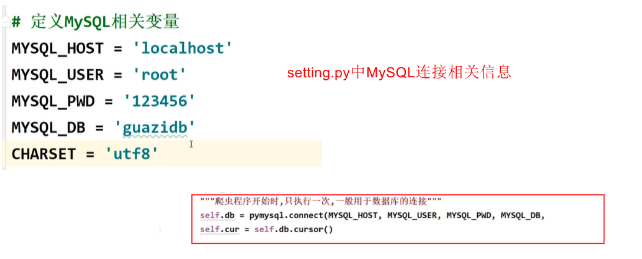

Scrapy怎么将数据保存到Excel和MySQL中

Scrapy是一个用Python实现的为了爬取网站数据、提取数据的应用框架。我们对于爬取到的数据存储到本地或数据库是经常要用到的操作。主要讲解两种保存方式:ExcelMySQL说明一下爬取到的数据:爬取豆瓣读书top250网页的相关信息:书名title、链接link、国家country、作者author... ...

0 回应 8 热度 -

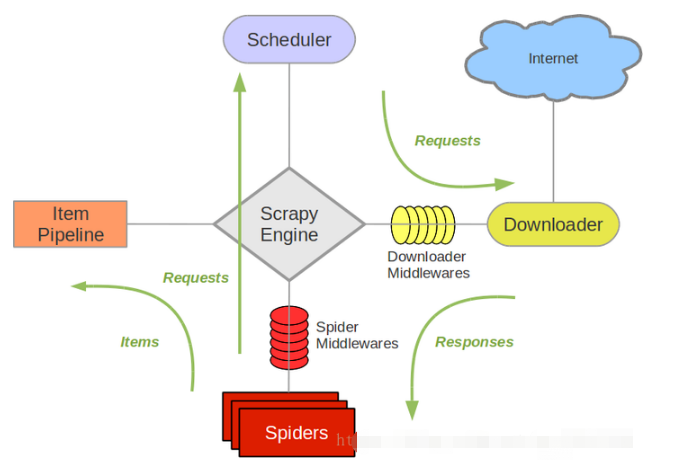

Python的Scrapy框架知识点有哪些

一.为什么使用Scrapy框架?Scrapy是一个快速、高层次的屏幕抓取和web抓取的框架,可用于数据挖掘、监测和自动化检测,任何人都可以根据需要去进行修改。二.Scrapy框架每个组件介绍1.Scrapy引擎(Scrapy Engine):负责控制数据流在系统的所以组件中的流动,并在相应动作发生时触发... ...

0 回应 3 热度 -

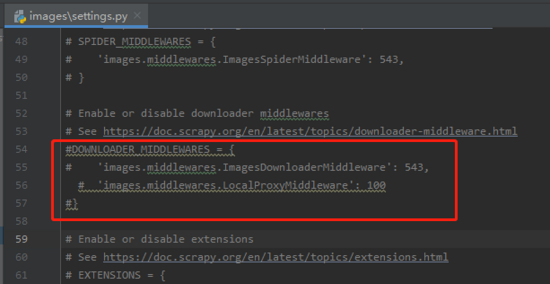

Python爬虫Scrapy框架IP代理如何配置与调试

代理ip的逻辑在哪里一个scrapy 的项目结构是这样的scrapydownloadertest#项目文件夹│items.py#定义爬取结果存储的数据结构│middlewares.py#中间件(可以理解java的过滤器拦截器)│pipelines.py#数据管道,对获取到的数据做操作│setti... ...

0 回应 5 热度 -

如何在Pycharm中安装Scrapy

Scrapy是一个开源的网络爬虫框架,Python编写的。最初设计用于网页抓取,也可以用来提取数据使用API或作为一个通用的网络爬虫。是数据采集不可必备的利器。安装pipinstallscrapy如果使用上面的命令太慢。国内可以使用豆瓣源进行加速。pipinstall-ihttps://pypi.dou... ...

0 回应 17 热度 -

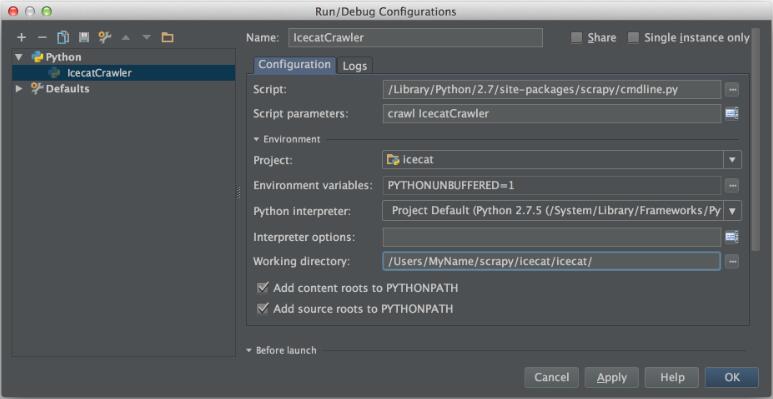

怎么在Pycharm中执行scrapy命令

当你检查scrapy二进制文件时,你会注意到这么一段python script#!/usr/bin/pythonfromscrapy.cmdlineimportexecuteexecute()这意味着 一个scrapy命令,比如 scrapy crawl IcecatCrawler也可以这么表达:... ...

0 回应 13 热度 -

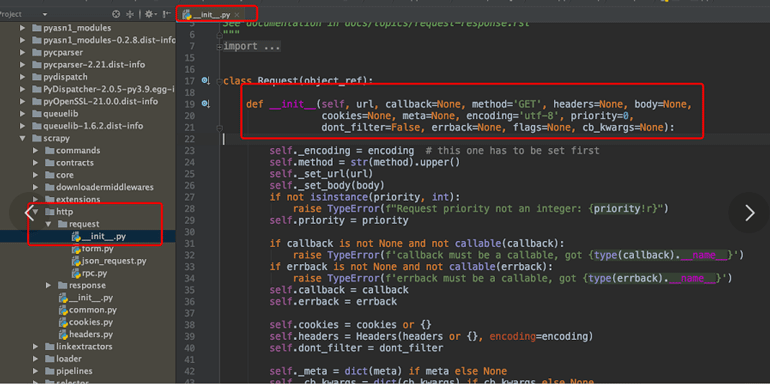

python scrapy框架中Request对象和Response对象怎么用

一、Request对象Request对象主要是用来请求数据,爬取一页的数据重新发送一个请求的时候调用,其源码类的位置如下图所示:这里给出其的源码,该方法有很多参数:classRequest(object_ref):def__init__(self,url,callback=None,method=&... ...

0 回应 3 热度 -

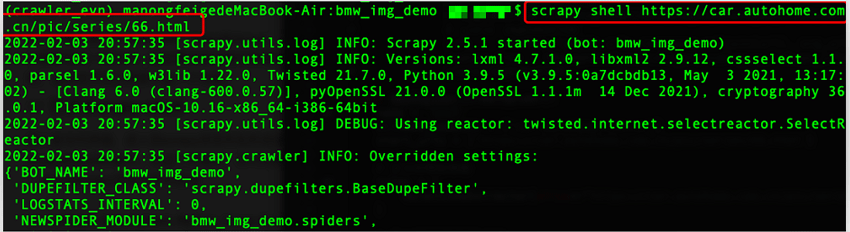

python Scrapy shell怎么使用

前言:我们想要在爬虫中使用xpath、beautifulsoup、正则表达式,css选择器等来提取想要的数据,但是因为scrapy是一个比较重的框架,每次运行都要等到一段时间,因此要去验证我们提取规则是否正确,是一个比较麻烦的事情,因此,scrapy提供了一个shell。用来方便的测试规则,当然也不仅仅... ...

0 回应 6 热度 -

Scrapy使用案例分析

scrapy是一个快速的高级web抓取和web抓取框架,用于抓取网站并从其页面中提取结构化数据。它可以用于广泛的用途,从数据挖掘到监控和自动化测试。安装首先,确定你的电脑上已经安装了 Python 3 以及对应的 pip。可以使用下面的命令查看:$python3--versionPython3.6.3... ...

0 回应 3 热度 -

网络爬虫框架Scrapy怎么用

Scrapy是用纯Python实现一个为了爬取网站数据、提取结构性数据而编写的应用框架,用途非常广泛。框架的力量,用户只需要定制开发几个模块就可以轻松的实现一个爬虫,用来抓取网页内容以及各种图片,非常之方便。安装首先,确定你的电脑上已经安装了 Python 3 以及对应的 pip。可以使用下面的命令查看... ...

0 回应 3 热度 -

scrapy调用parse()和parse()调用func()的方法

在scrapy中调用parse()方法,parse()方法中调用其他函数func(),func需要返回Item,使用方法如下:#在parse()中调用其他yield函数,需要写成写成循环并yield其中的内容defparse():#正确调用foriteminparse_comment(a,b):yiel... ...

0 回应 19 热度 -

scrapy爬虫框架怎么使用

一、scrapy爬虫框架介绍在编写爬虫的时候,如果我们使用 requests、aiohttp 等库,需要从头至尾把爬虫完整地实现一遍,比如说异常处理、爬取调度等,如果写的多了,的确会比较麻烦。利用现有的爬虫框架,可以提高编写爬虫的效率,而说到 Python 的爬虫框架,Scrapy 当之无愧是最流行最强... ...

0 回应 14 热度