-

Python安装jieba库的方法是什么

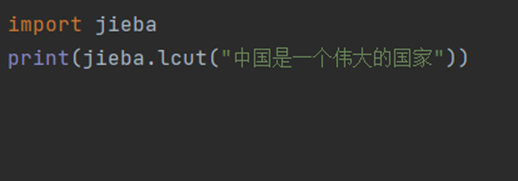

安装jieba库教程jieba库是一款优秀的 Python 第三方中文分词库,jieba 支持三种分词模式:精确模式、全模式和搜索引擎模式,下面是三种模式的特点。精确模式:试图将语句最精确的切分,不存在冗余数据,适合做文本分析全模式:将语句中所有可能是词的词语都切分出来,速度很快,但是存在冗余数据搜索引... ...

0 回应 8 热度 -

Python中jieba库如何使用

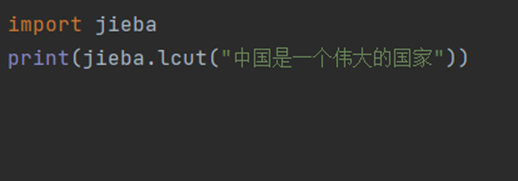

一、jieba库基本介绍(1)jieba库概述①jieba是优秀的中文分词第三方库②中文文本需要通过分词获得单个的词语③jieba是优秀的中文分词第三方库,需要额外安装 ④jieba库提供三种分词模式,最简单只需掌握一个函数(2)jieba分词的原理①分词依靠中文词库② 利用一个中文词库,确定汉字之间... ...

0 回应 8 热度 -

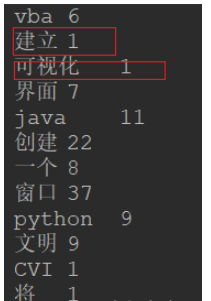

Python jieba分词怎么添加自定义词和去除不需要长尾词

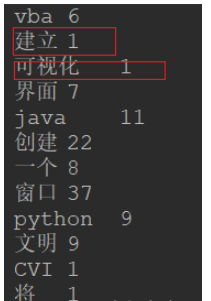

通过如下代码,读取一个txt的高频词汇:#找到高频词汇tmp_content=self.getContent(tmp_path)keyword_list=tmp_content.split('\n')word_count=dict()forkeywordinkeyword_lis... ...

0 回应 4 热度 -

Python安装jieba库的方法是什么

安装jieba库教程jieba库是一款优秀的 Python 第三方中文分词库,jieba 支持三种分词模式:精确模式、全模式和搜索引擎模式,下面是三种模式的特点。精确模式:试图将语句最精确的切分,不存在冗余数据,适合做文本分析全模式:将语句中所有可能是词的词语都切分出来,速度很快,但是存在冗余数据搜索引... ...

0 回应 3 热度 -

Python中jieba库如何使用

一、jieba库基本介绍(1)jieba库概述①jieba是优秀的中文分词第三方库②中文文本需要通过分词获得单个的词语③jieba是优秀的中文分词第三方库,需要额外安装 ④jieba库提供三种分词模式,最简单只需掌握一个函数(2)jieba分词的原理①分词依靠中文词库② 利用一个中文词库,确定汉字之间... ...

0 回应 4 热度 -

Python jieba分词怎么添加自定义词和去除不需要长尾词

通过如下代码,读取一个txt的高频词汇:#找到高频词汇tmp_content=self.getContent(tmp_path)keyword_list=tmp_content.split('\n')word_count=dict()forkeywordinkeyword_lis... ...

0 回应 5 热度 -

Python中jieba分词模块的用法

0、前言 jieba库是进行中文分词的利器,根据文档描述,具有以下特点: 分词 提取关键词 搜索词汇位置 2、提取词汇 在处理词汇时,常常我们会提取出现频率比较高的关... ...

0 回应 38 热度 -

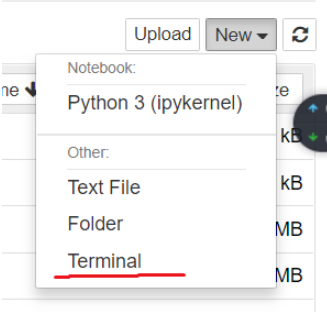

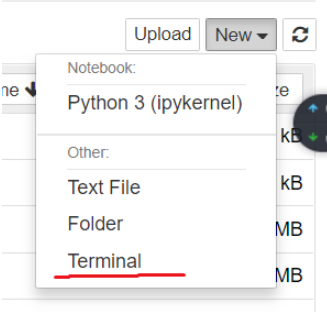

python如何安装jieba

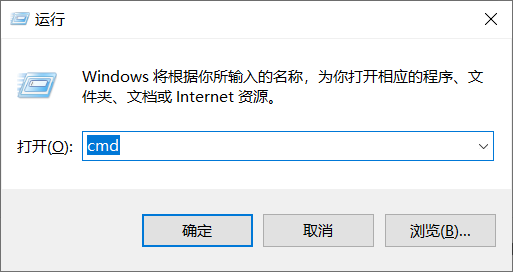

使用 pip 安装 jieba 库按WIN+R 键打开运行,输入 cmd 点击确定进入 cmd 命令提示符。使用pip install jieba,可以快速安装 jieba 库。临时使用国内源在 pip 的指令后面带上参数 -i。pip install numpy -i https://pypi.tun... ...

0 回应 14 热度 -

python中jieba模块怎么使用

一、前言 英语单词之间是通过空格分隔的,但是中文却不存在空格的概念,因此需要一个模块来解决中文的分词问题。jieba模块是一个python第三方中文分词模块,可以用于将语句中的中文词语分离出来。二、模块的安装jieba模块作为python的一个第三方模块,是需要我们自行下载安装后才能使用的,我们主要... ...

0 回应 26 热度 -

如何在python中使用jieba库

python可以做什么Python是一种编程语言,内置了许多有效的工具,Python几乎无所不能,该语言通俗易懂、容易入门、功能强大,在许多领域中都有广泛的应用,例如最热门的大数据分析,人工智能,Web开发等。一、jieba库概述jieba是优秀的中文分词第三方库中文文本需要通过分词获得单个的词语jie... ...

0 回应 12 热度